El algoritmo y el racismo: Las redes sociales no son neutrales

Por Jonh Jak Becerra [*]

En la era contemporánea solemos repetir —con una fe casi religiosa— que la humanidad ha avanzado. Que somos más conscientes, más diversos, más justos. Sin embargo, ese relato del progreso se resquebraja cuando observamos con atención cómo el racismo antinegro no solo persiste, sino que se adapta, se sofistica y se vuelve menos visible. Hoy ya no necesita gritar insultos en la calle ni escribir leyes explícitas de exclusión; le basta con habitar silenciosamente el código, los datos y los algoritmos que organizan nuestra vida digital.

Como activista antirracista, no puedo ignorar lo que ocurre en las redes sociales. Mucho menos en territorios como América Latina y, en particular, Colombia, donde el racismo histórico convive con una narrativa oficial de mestizaje que insiste en negarlo. En este nuevo escenario, el internet —y especialmente el algoritmo— se ha convertido en un espacio clave donde se reproducen viejas jerarquías con ropajes tecnológicos.

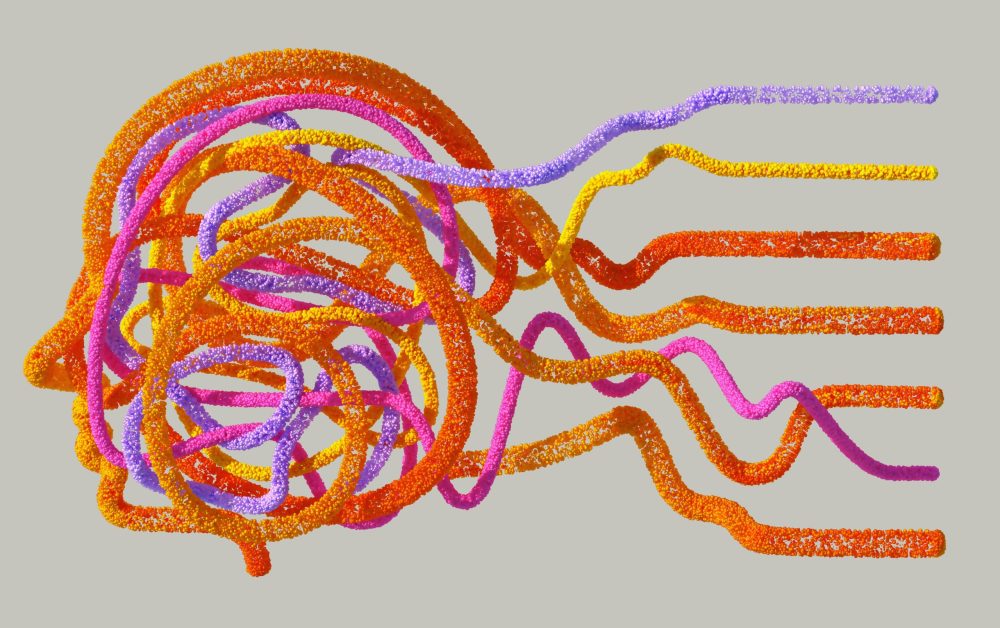

No es que el algoritmo “odie” a nadie. No siente. No tiene emociones. Pero toma decisiones basadas en datos desiguales, refuerza patrones sociales existentes —como los perfiles raciales asociados a territorios, pobreza o criminalidad— y, además, carece de marcos éticos sólidos y de diversidad en su diseño y gobernanza. Por eso, más que un juez imparcial, el algoritmo funciona como un espejo… sí, pero un espejo distorsionado de los prejuicios de la sociedad que lo creó.

En el siglo XX, especialmente después de la Segunda Guerra Mundial y de las luchas por los derechos civiles, el racismo biológico explícito perdió legitimidad pública. Ya no era aceptable hablar abiertamente de razas “superiores” e “inferiores”. Pero el racismo no desapareció; se reconfiguró. Se volvió económico, simbólico y epistémico. W. E. B. Du Bois ya lo había advertido en The Souls of Black Folk (1903): la línea del color no solo separa por la violencia directa, sino por el acceso al conocimiento, a la dignidad y a la posibilidad de ser plenamente humano.

Esa advertencia sigue siendo vigente, ahora amplificada por la tecnología.

Achille Mbembe, en Necropolítica, lo formula con crudeza cuando explica que el racismo es una tecnología del poder. No se trata únicamente de excluir; se trata de administrar la vida y la muerte. Decidir quién es prescindible, quién merece protección y quién puede morir lentamente —por hambre, por precariedad, por olvido—. Cuando llevamos esa lógica al mundo digital, entendemos que las redes sociales nunca han sido neutras. Nunca lo fueron. Nunca lo serán.

Pensemos en un ejemplo concreto: si un algoritmo utiliza datos históricos sobre quién es arrestado en una ciudad, y esos datos reflejan prácticas policiales racistas, la herramienta no corrige el problema; lo profundiza. La tecnología no limpia el sesgo, lo automatiza. En el Reino Unido, por ejemplo, se ha denunciado el uso de sistemas de policía predictiva que reproducen la vigilancia desproporcionada sobre comunidades negras. Lo que se presenta como “prevención” termina siendo una actualización digital del perfilamiento racial.

Pero el racismo algorítmico no siempre se manifiesta de forma tan evidente. A veces se cuela en lo cotidiano, en lo aparentemente inocente. Recuerdo una experiencia personal: tenía un celular con poco almacenamiento, y la aplicación de fotos de Google me ofreció liberar espacio borrando “imágenes borrosas”. Cuando revisé esa carpeta, la mayoría de las fotos señaladas eran de personas negras. Entre ellas, una imagen de Marcus Garvey. Otras eran fotos mías. El algoritmo había decidido, sin rubor alguno, que esos rostros no merecían claridad. Puede parecer un detalle menor. No lo es.

Las redes sociales no son simples herramientas; son arquitecturas de control diseñadas con objetivos muy claros. Su modelo de negocio se basa en la economía de la atención. El algoritmo no busca verdad ni justicia; busca que permanezcas conectado. Y en ese proceso, el contenido que genera indignación, miedo o refuerza estereotipos suele circular más rápido que aquel que educa o incomoda al poder.

En un país como Colombia, con una de las poblaciones afrodescendientes más grandes de la región, esta falta de neutralidad no es un problema técnico; es un problema político. Cuando los sistemas de recomendación invisibilizan nuestras realidades territoriales —el Pacífico, el Caribe, las periferias urbanas— están reproduciendo la exclusión histórica con nuevas herramientas.

Lo veo a diario en las redes. Jóvenes creadores de contenido negros y afrodescendientes producen material antirracista de alta calidad, con investigación seria, con datos, con reflexión crítica sobre racismo, mestizaje y colonialidad. Sin embargo, el algoritmo les reduce el alcance, los restringe, los marca como “sensibles”. Mientras tanto, una persona blanca o mestiza aborda los mismos temas —a veces con errores evidentes— y su contenido se vuelve viral, educativo, celebrado.

He visto a una mujer blanca explicar la vida de Nina Simone con datos imprecisos y obtener miles de interacciones. Al mismo tiempo, una joven negra narraba esa misma historia desde la memoria y la herida, pero su alcance era mínimo. Recuerdo también a un joven blanco hablando de las Panteras Negras, con información incorrecta, y aun así el algoritmo lo posicionó con más de veinte mil reacciones. No importaba la exactitud. Importaba la voz.

Aquí el racismo se vuelve sofisticado: no censura explícitamente, jerarquiza. Decide quién es legítimo para hablar y quién debe ser silenciado. Castiga a quien nombra el racismo y premia a quien lo explica desde una distancia cómoda.

La doctora Safiya Umoja Noble lo expone con claridad en Algorithms of Oppression (2018): los motores de búsqueda y las plataformas digitales no reflejan la realidad tal cual es, sino que reproducen las estructuras de poder existentes. Ruha Benjamin, por su parte, llama a este fenómeno el New Jim Code: un sistema donde la tecnología reproduce desigualdades raciales de forma encubierta, bajo la apariencia de neutralidad y eficiencia.

Por eso insisto: las redes sociales no son neutrales. En el contexto colombiano, los algoritmos actúan como jueces silenciosos. Importamos tecnologías que no reconocen nuestra diversidad étnico-racial y, al hacerlo, corremos el riesgo de automatizar el racismo, de convertir la exclusión histórica en una decisión matemática.

Nombrar esto no es paranoia ni resentimiento. Es una urgencia política y ética. Porque mientras no cuestionemos el algoritmo, el racismo seguirá operando —no a gritos, sino en silencio— decidiendo quién es visible, quién es escuchado y quién, una vez más, queda fuera de la conversación.

[*] Jonh Jak Becerra Palacios es un activista antirracista colombiano, especializado en estudios afrolatinoamericanos y en la historia de la diáspora africana.